在Claude Code中使用DeepSeek v3.1模型:完整指南

在Claude Code中使用DeepSeek v3.1模型:完整指南

August 21, 2025

DeepSeek v3.1 模型介绍

DeepSeek v3.1 于 2025 年 8 月 21 日发布,是在 V3 基础上的重要升级,具有以下核心特性:

- 混合推理架构:同一模型支持“非思考模式”和“思考模式”,分别对应

deepseek-chat与deepseek-reasoner,便于在速度与推理深度间灵活取舍。 - 128K 上下文长度:更长上下文,适合代码库分析、长文档处理与多文件协作。

- 思考效率提升:在思维链压缩后,V3.1-Think 用更少的 tokens 达到与 R1-0528 近似的效果。

- 工具与智能体能力增强:在代码修复(SWE)与复杂终端任务(Terminal-Bench)上显著提升,更适合工具调用/多步任务。

- Function Calling(strict)支持:Beta 接口支持严格模式,确保函数输出满足 schema(详见官方文档)。

- Anthropic API 兼容:可直接以 Anthropic API 形式接入 Claude Code 与其生态。

参考:

- DeepSeek V3.1 发布说明:DeepSeek V3.1 发布 2025/08/21

Claude Code 安装指南

系统要求

- macOS、Windows 或 Linux 系统

- Node.js 16+ 版本

- 稳定的网络连接

安装步骤

- 下载 Claude Code

- 访问 Claude Code 官网 下载对应版本的安装包

- 或者通过 npm 安装:

npm install -g @anthropic-ai/claude-code

在 Claude Code 中配置 DeepSeek v3.1

按照 Anthropic API 兼容规范,Claude Code 只需设置以下环境变量即可切换到 DeepSeek 模型:

设置环境变量(临时会话)

# DeepSeek 提供的 Anthropic 兼容入口

export ANTHROPIC_BASE_URL=https://api.deepseek.com/anthropic

# 使用 DeepSeek 的 API Key(Claude Code 读取 ANTHROPIC_AUTH_TOKEN)

export ANTHROPIC_AUTH_TOKEN="${DEEPSEEK_API_KEY}"

# 默认主模型(非思考模式)

export ANTHROPIC_MODEL=deepseek-chat

# 快速小模型(同样可设为 deepseek-chat)

export ANTHROPIC_SMALL_FAST_MODEL=deepseek-chat若希望在 Claude Code 中启用“思考模式”,将 ANTHROPIC_MODEL 改为:

export ANTHROPIC_MODEL=deepseek-reasoner提示:上述方式仅对当前 shell 会话生效。若需长期生效,可将这些

export行加入~/.zshrc或~/.bashrc。

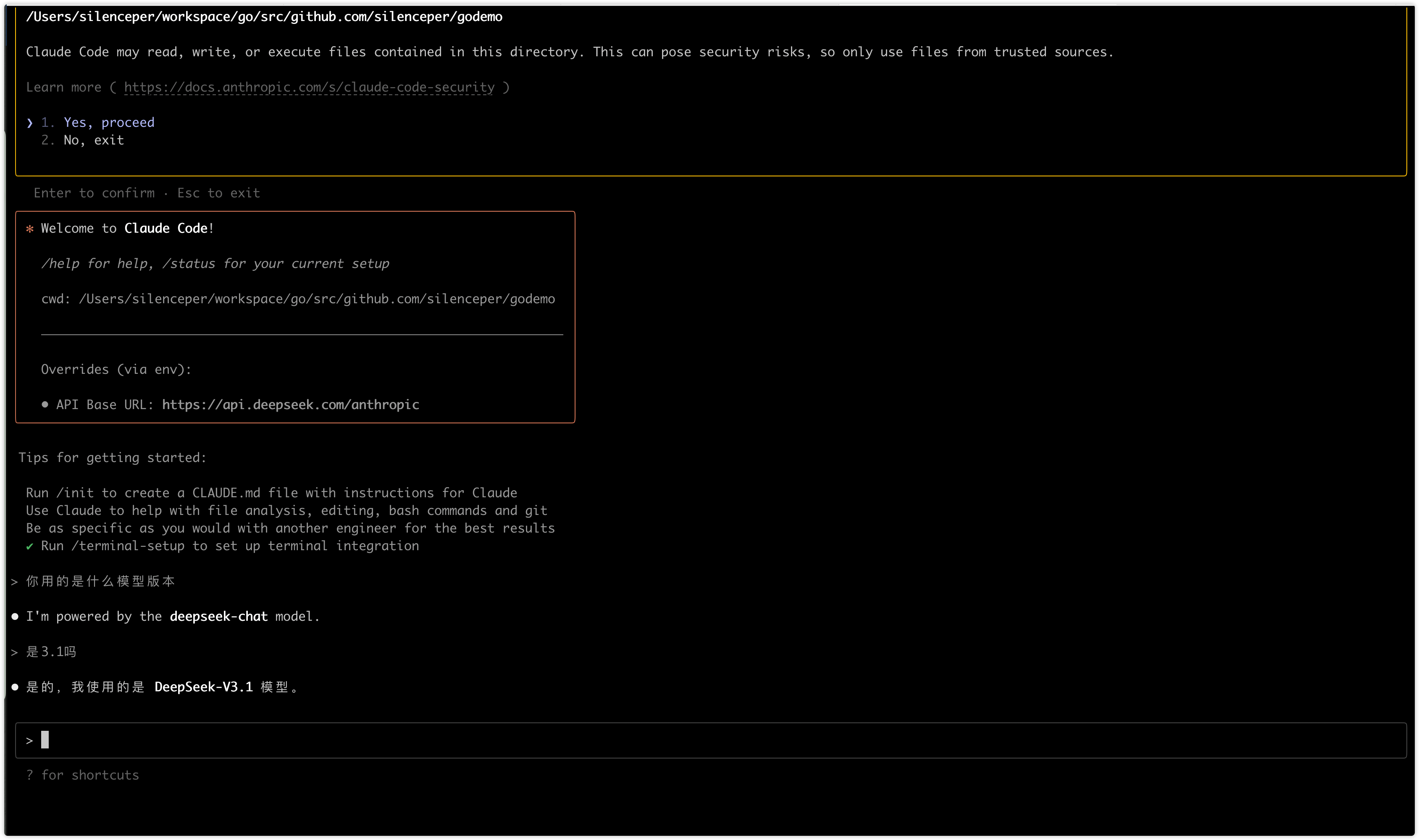

启动与验证

cd your-project

claude启动后,Claude Code 将读取环境变量并使用 DeepSeek 模型。你可以直接在命令行对话进行代码协作与修改。若需确认模型,查看启动日志或在会话中询问当前模型配置。

更多兼容细节与字段支持矩阵,参考官方文档:Anthropic API 指南。

常见问题与注意事项

- 模型与模式选择:

deepseek-chat:非思考模式,响应更短更快。deepseek-reasoner:思考模式,适合复杂多步推理场景。

- 上下文长度:V3.1 API 默认支持 128K 上下文,适合长文档/多文件协作。

- 工具调用与函数:支持

tools与tool_choice(none/auto/any/tool)。Beta 接口支持 strict Function Calling 以保证输出符合 schema(以官方文档为准)。 - 字段兼容性要点:

temperature(0.0~2.0)、max_tokens、system、stream均支持。thinking字段在兼容模式下被忽略;图片/文档/搜索结果等部分复杂 message 类型暂不支持。

- Tokenizer/模板差异:V3.1 对分词器与 chat template 有较大调整,与 V3 存在差异,迁移前请阅读新版说明。

参考:

参考资料

- DeepSeek 官方文档 · 新闻:DeepSeek V3.1 发布 2025/08/21

- DeepSeek 官方文档 · 指南:Anthropic API